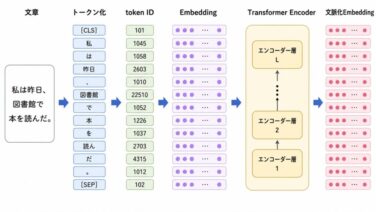

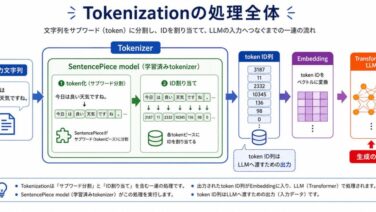

AI関連論文

AI関連論文 Patch Forcingとは?画像生成をパッチごとの難しさで適応的に進める仕組み

Patch Forcingとは、画像をパッチごとの難しさに応じて異なる速度で生成する適応サンプリング手法です。LTG sampler、difficulty head、dual-loop、look-aheadの仕組みを、Flow Matchingの数式とImageNet・Text-to-Imageの実験結果から解説します。

AI関連論文

AI関連論文  AI関連論文

AI関連論文  AI関連論文

AI関連論文  AI関連論文

AI関連論文  AI関連論文

AI関連論文  AI関連論文

AI関連論文  AI関連論文

AI関連論文  AI関連論文

AI関連論文  AI関連論文

AI関連論文  AI関連論文

AI関連論文  AI関連論文

AI関連論文  AI関連論文

AI関連論文  AI関連論文

AI関連論文  AI関連論文

AI関連論文  AI関連論文

AI関連論文  AI関連論文

AI関連論文  AI関連論文

AI関連論文  AI関連論文

AI関連論文  AI関連論文

AI関連論文  AI関連論文

AI関連論文  カメラ

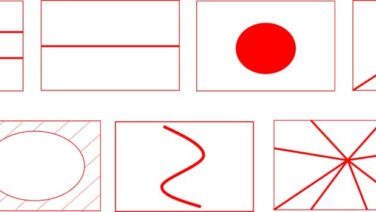

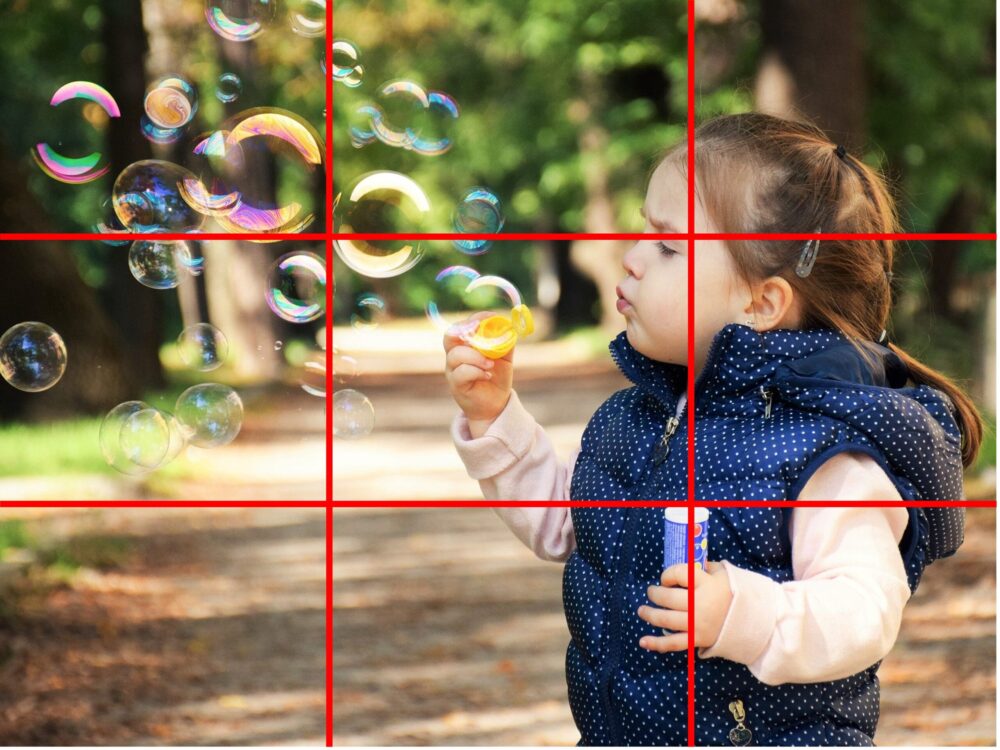

カメラ  カメラ

カメラ  カメラ

カメラ  カメラ

カメラ  カメラ

カメラ  カメラ

カメラ  カメラ

カメラ  カメラ

カメラ  カメラ

カメラ  カメラ

カメラ  映画

映画  映画

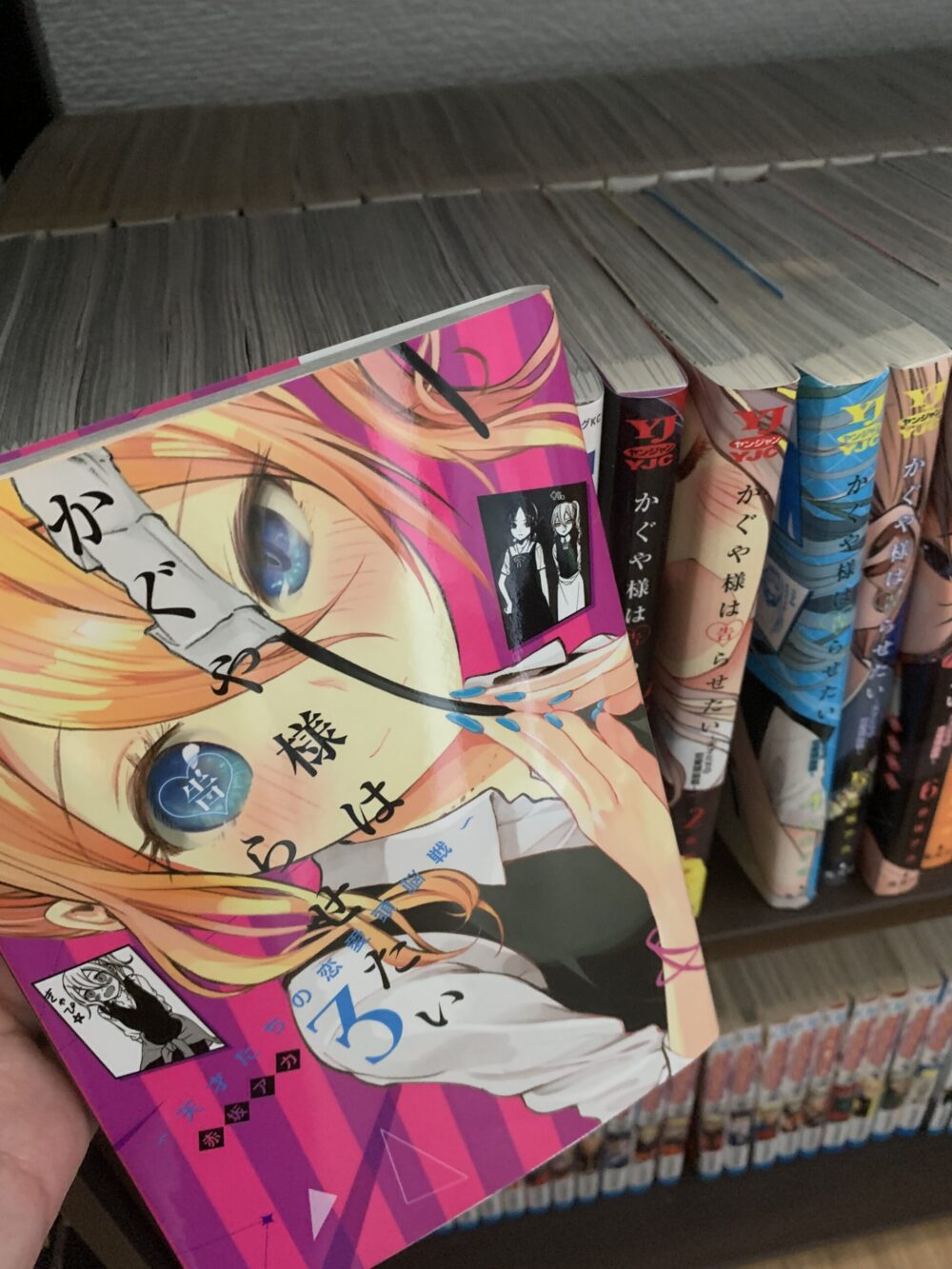

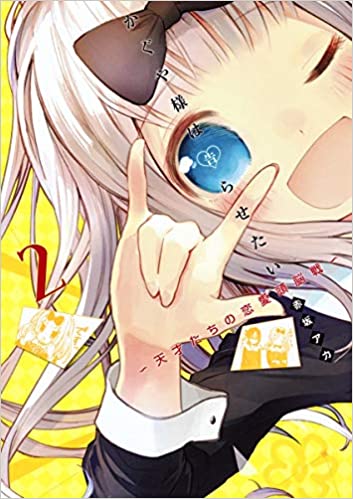

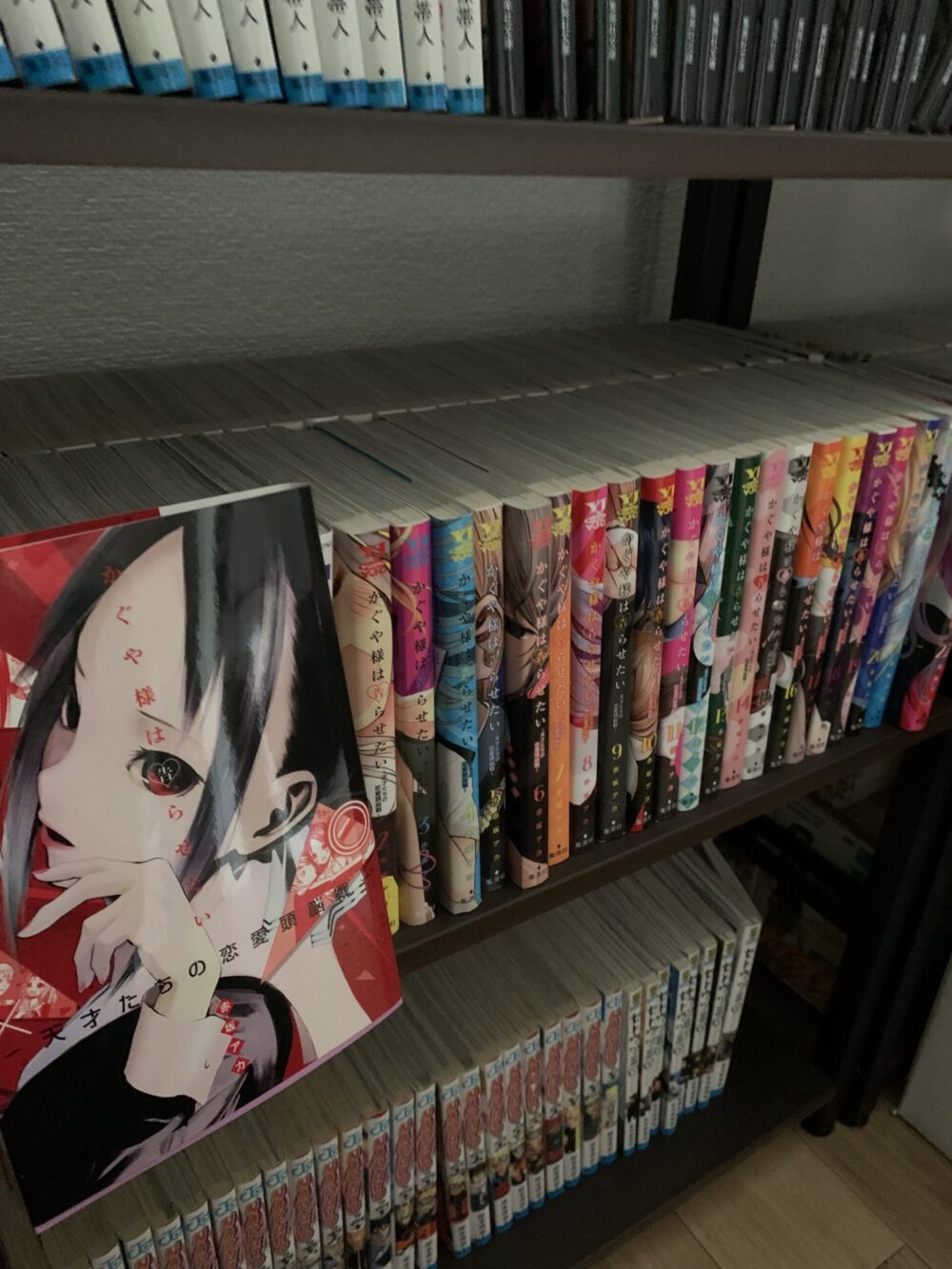

映画  かぐや様は告らせたい~天才たちの恋愛頭脳戦~

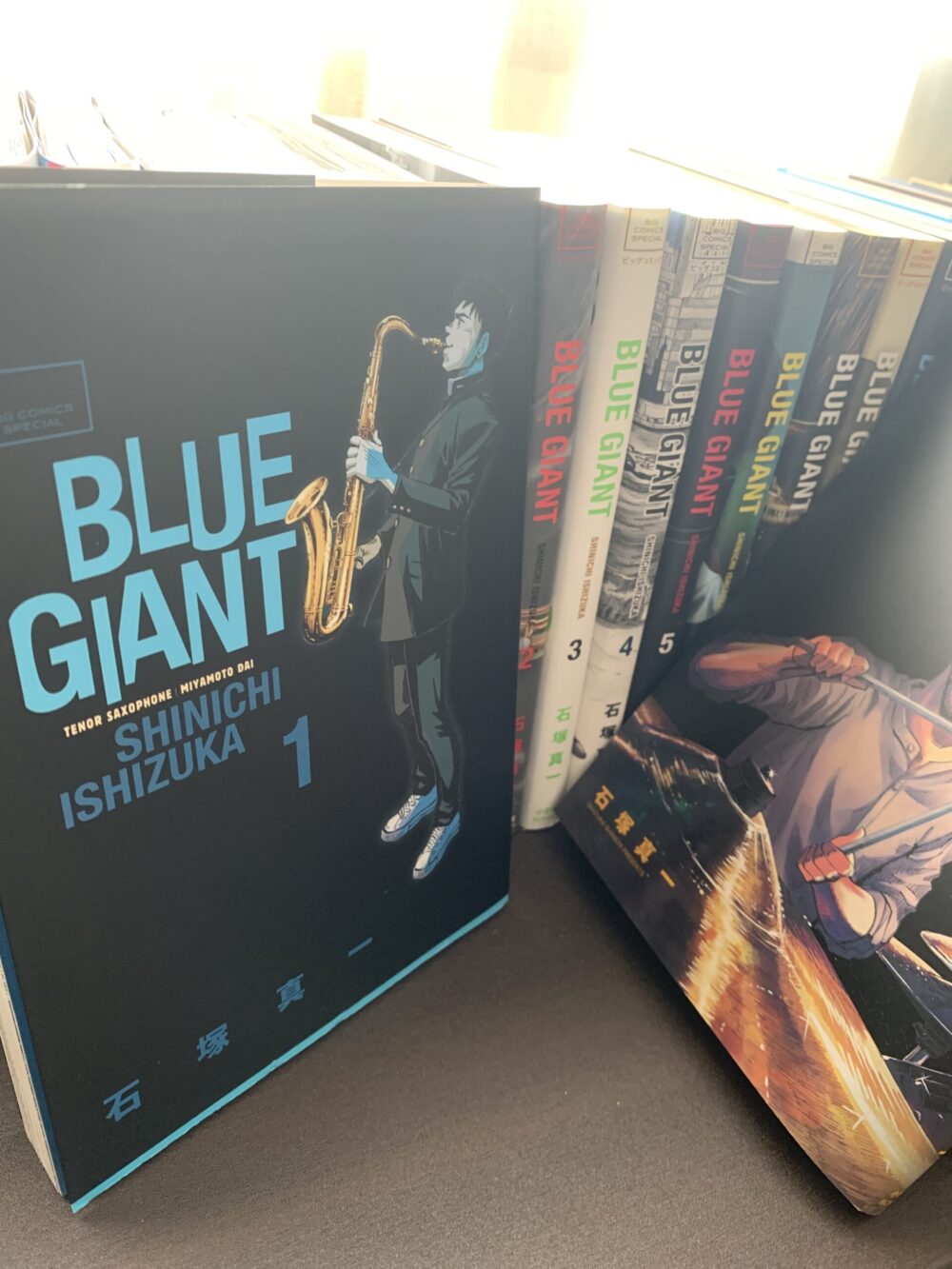

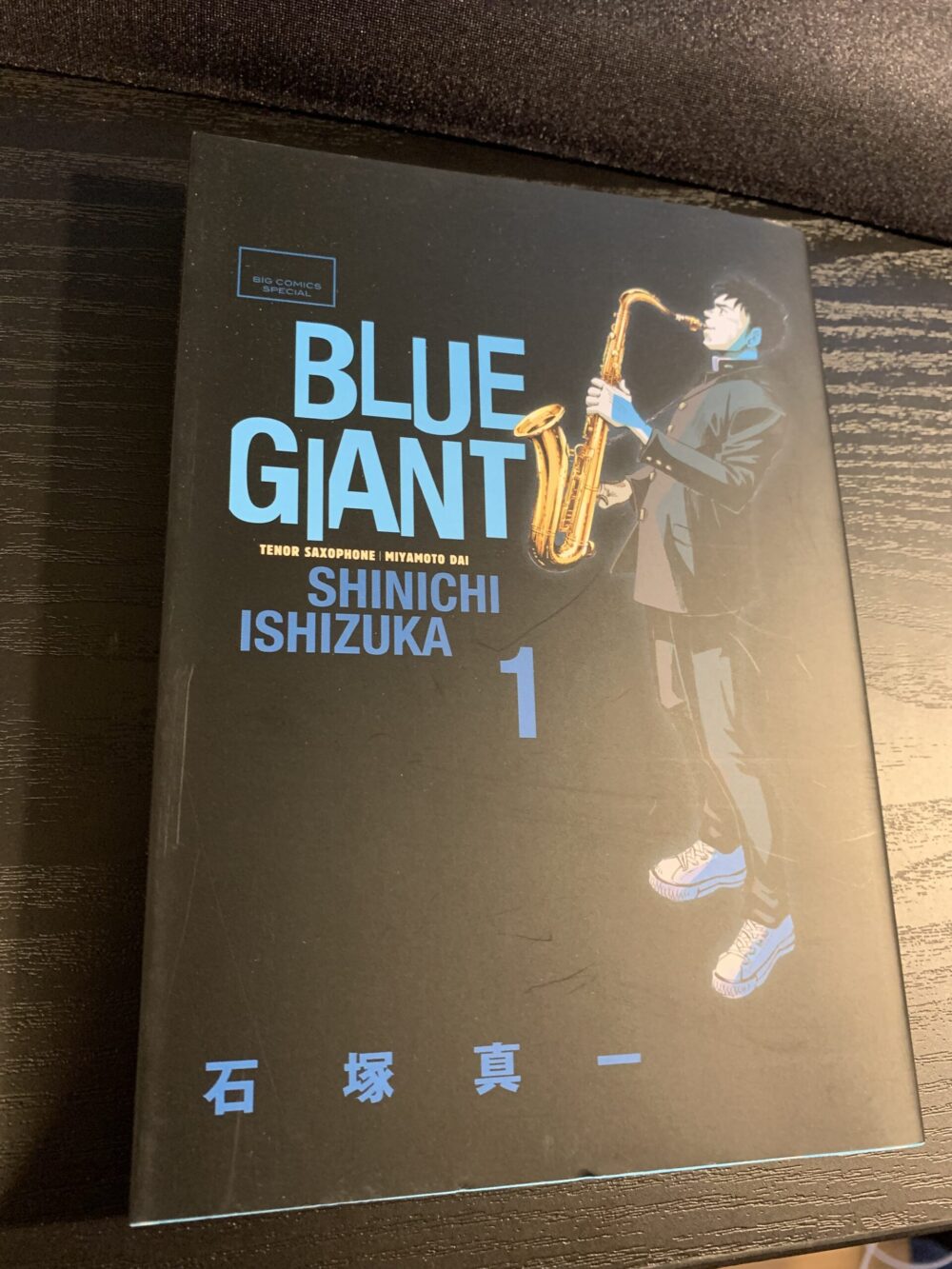

かぐや様は告らせたい~天才たちの恋愛頭脳戦~  BLUE GIANT

BLUE GIANT  かぐや様は告らせたい~天才たちの恋愛頭脳戦~

かぐや様は告らせたい~天才たちの恋愛頭脳戦~  かぐや様は告らせたい~天才たちの恋愛頭脳戦~

かぐや様は告らせたい~天才たちの恋愛頭脳戦~  BLUE GIANT

BLUE GIANT